ChatGPT revolucionó la forma en que interactuamos con la tecnología. Desde su lanzamiento en noviembre de 2022, esta herramienta de lenguaje generativo, desarrollada por OpenAI, permitió a millones de personas interactuar con la inteligencia artificial de manera natural y fluida.

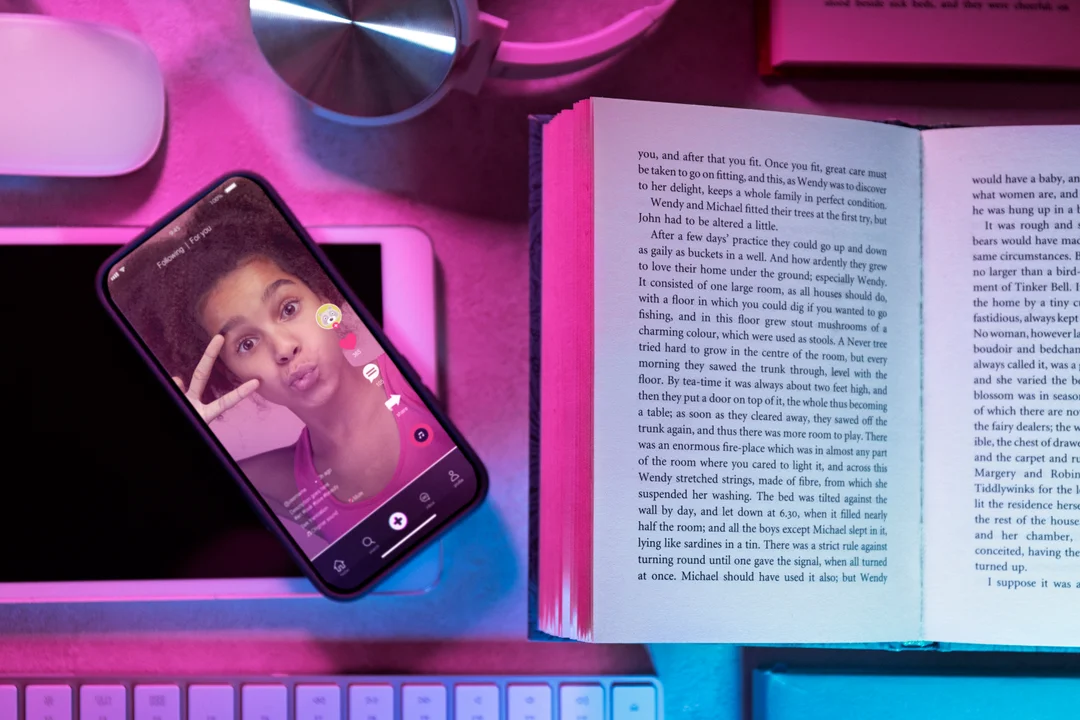

La reciente actualización de GPT-4o, que incluye la capacidad de generar imágenes, generó un boom en las redes sociales el fin de semana pasado: miles de usuarios subieron sus fotos al chatbot para crear ilustraciones de diferentes estilos, mayormente similares a las películas del Studio Ghibli.

Sin embargo, detrás de esta tendencia aparece un importante riesgo de seguridad que podría comprometer la privacidad de los usuarios: Open AI podría hacerse de millones de fotos con las caras de los usuarios y sus familiares y amigos.

El debate central de esta cuestión es qué se hace con todos los datos que se suben a las herramientas de inteligencia artificial y quién controla toda esa información.

Por ese motivo, y para evitar filtraciones, hackeos y otro tipo de riesgos de ciberseguridad, es importante tomar conciencia de lo que compartimos con estas herramientas.

Acá hay cinco tipos de información que nunca hay que compartir con ChatGPT o cualquier otro chatbot de IA para proteger la privacidad y seguridad:

- 1. Imágenes con datos biométricos

Compartir imágenes personales, especialmente aquellas en las que aparece tu cara, puede exponer datos biométricos a la IA y la empresa detrás de ella. Aunque es divertido crear ilustraciones al estilo de Studio Ghibli, o cualquier otro, es importante saber que estas imágenes pueden ser utilizadas para recopilar información biométrica.

- 2. Datos personales

Información como número de documento, fecha de nacimiento, dirección o trayectos habituales debe mantenerse en privado. La IA puede aprender mucho, pero no siempre es seguro compartir estos detalles, ya que pueden ser utilizados para identificar o comprometer la seguridad de las personas.

- 3. Resultados médicos

Compartir información médica confidencial, como diagnósticos o resultados de pruebas, no solo es innecesario sino que también puede filtrarse. ChatGPT no es un médico y por más que se le pregunte, no puede proporcionar diagnósticos precisos, por lo que es mejor mantener esta información fuera de su alcance.

- 4. Datos bancarios

Aunque pueda parecer obvio, no está de más recomendar que nunca se debe compartir números de tarjetas de crédito, claves de acceso a cuentas bancarias o detalles de transacciones financieras, ni con la IA ni con nadie a través de internet. Aunque ChatGPT está diseñado para respetar la privacidad, no ofrece el mismo nivel de seguridad que un sitio web bancario, lo que lo hace vulnerable a ataques cibernéticos.

- 5. Información corporativa confidencial

Si se usa ChatGPT para tareas del trabajo no se debe compartir información confidencial de la empresa.

Comunicadora y amante del true crime, Locutora/conductora en «Kaos En La Mañana».